복잡한 것도 아니고.. 모른다고 할 것도 아니고 최신의 정보도 아닌!!!!!!

단순 계단을 chat GPT에게 지시했습니다..

작은애 수학 문제를 푸는데 .. 모르겠다고 도와달라는데 ㅠㅠ 계산을 하기가 너~~~~~~~~~~~~무 귀찮은 거예요 ㅋㅋㅋㅋ

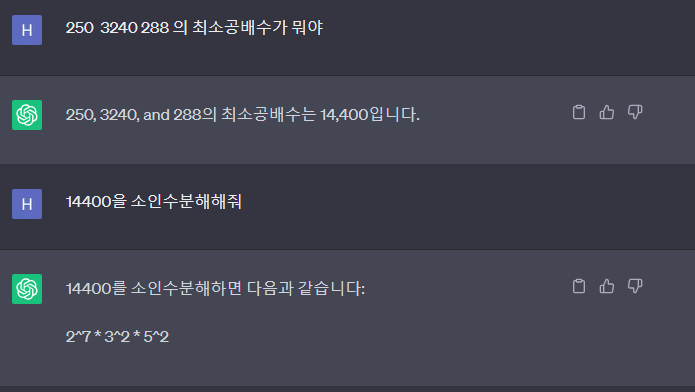

그래서 지시 ..

답을 바로 알려줍니다..

근데 인수를 계산해서 왜 그런지를 풀이를 설명해야해서 소인수분해도 시킵니다..

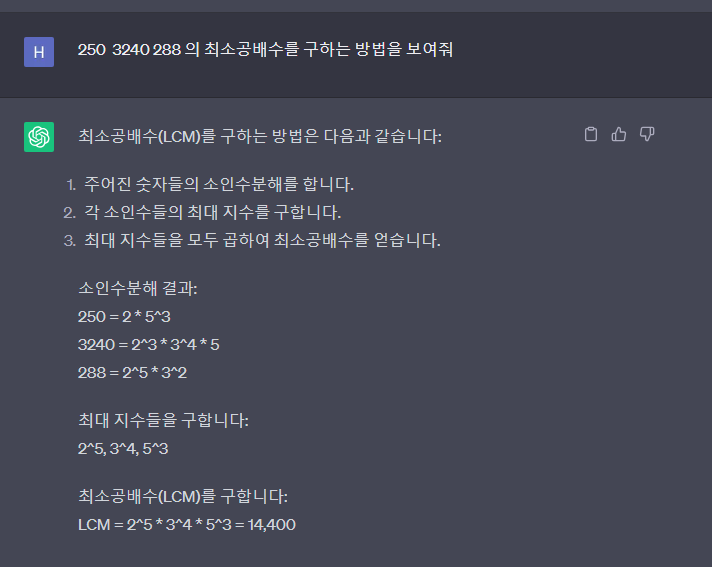

오케이 .. 근데.. 제가 아까 250 3240 288 을 소인수 분해 했을 때 나온 인수 조합으로 도저히 말이 안되는 .. 분해 입니다..

3240에 이미 3의 4제곱이 있는데........???? ..어떻게 최소 공배수가 3의 제곱???????

검산을 해봐도.. 14400의 소인수분해는 저게 아닙니다..

뭐지 .. ㅠㅠ 내가 이제 소인수분해도 못하나? chat GPT가 계산을 틀릴 리는 없으니.. ㅠㅠ 내가 틀린건데.. ㅠㅠ 흑 .......

두번 더 해봐도 안나옵니다..

설마????????????

하고 아예 최소공배수 구하는 식을 내 놓으라고 해봅니다..

............=-= ........... 얘 왜이래요?? 소인수 분해도 못합니다.. ㅋㅋㅋㅋㅋㅋ chat GPT 너 믿어도 ..되니????????

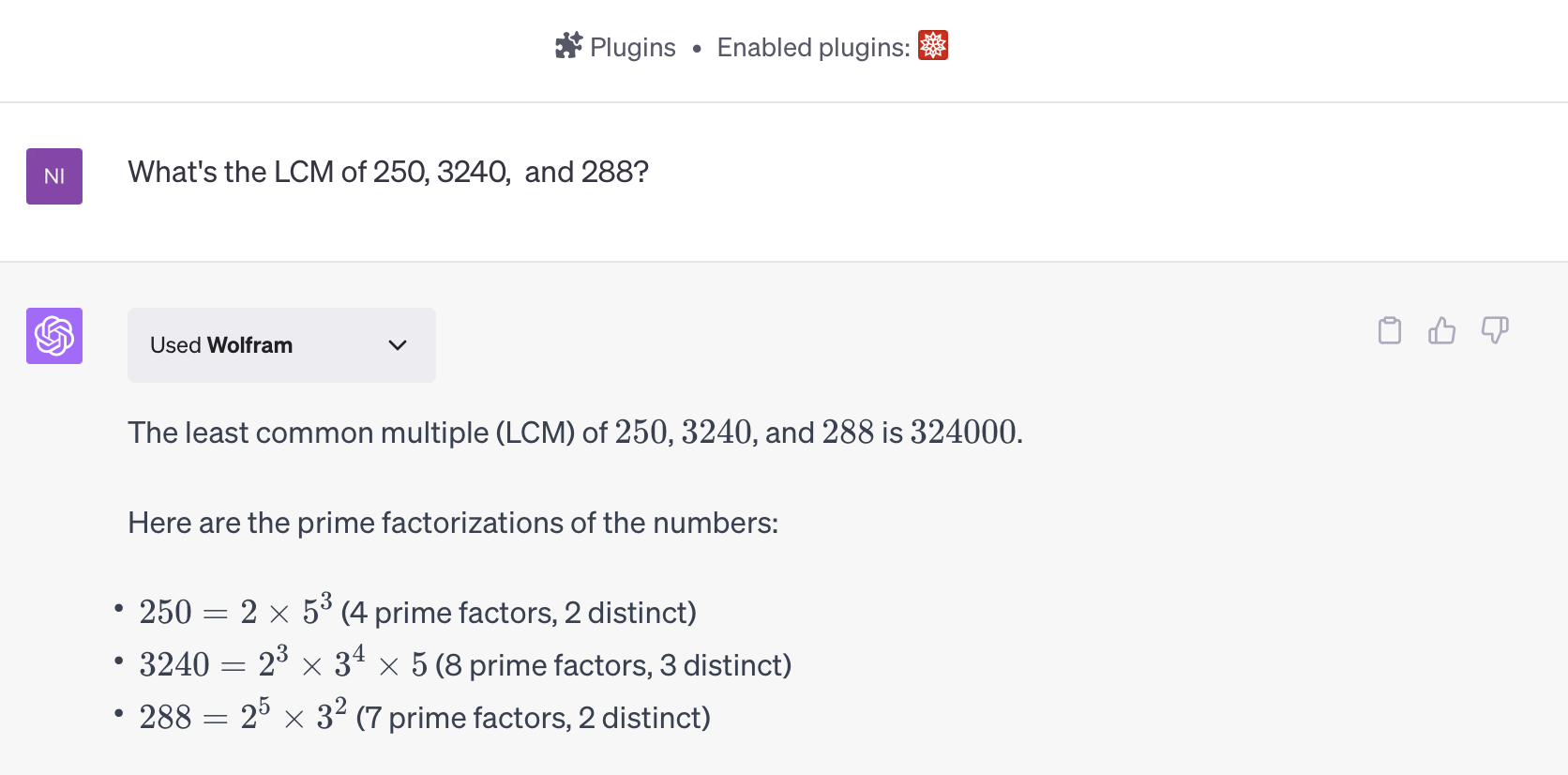

Gpt4로 업글하면 잘 풀까요?

그르게요..아니 근데 4 아니어도 이정도는 해내야 하는 거 아닌가유! 지는 컴퓨터인디! ㅎㅎ

ChatGPT는 언어 모델이지 수학은 시키시면 안됩니다! 다만 ChatGPT Plus를 사용해서 GPT-4에 Wolfram plugin을 연결시키면 어려운 문제도 잘 풉니다. 수학은 전문가에게!

> chat GPT가 계산을 틀릴 리는 없으니..

ChatGPT는 그럴듯한 말을 만들어내는 언어모델이지 정확한 사실 (수학/코딩/팩트체킹 등) 을 알려주는게 아닙니다.

이런이런 컴퓨터이니 당연히 ㅠㅠ 계산따위는 가능할줄요.. 엑셀도 얘가 다 해주고 .. 각종 자격 시험도 통과하는 모델이니 수학 계산쯤이야! 라고 생각했습니다~

ChatGPT에 수학은 물어보면 안된다...큰 교훈이네요.

전 요즘 메일 쓸 때마다 한번씩 점검받아요. 이메일에 조금 더 자신감이 생기는 느낌...아닌 느낌

참고문헌 찾으라고 해보니 너무 잘 보여 주던데 확인해보니 정작 그런 논문들은 하나도 없더군요

간단한거 비교해달라고 했더니 말은 그럴싸한데 다 틀렸더군요 -_-

세종대왕께서 맥북 집어던진 이야기, 이순신장군이 쓰던 라이트세이버에 대해 알려달라고 하면 그럴싸하게 잘 써주더라구요 ㅎㅎ

사실관계 관련된 것은 신뢰하면 안됩니다.

단, 수학 말고 social studies 같은건 구글 bard가 더 답안에 가깝게 알려주는 느낌이에요.

바드랑도 놀아봐야겠습니다 감사합니당

GPT 4로 지난주에 업그레이드 하고, 오늘자로 업데이트 된 GPT 써봤는데요, 나날이 성능은 좋아지고 있는거 같습니다 (연산은 안시켜봤어요).

저는 주로 이메일 작성할 때, 그리고 논문 읽으면서 이해가 잘 안되는 부분 문답할 때 쓰는데요.

특히 논문 읽으면서 이해가 잘 안되는 부분 (or 해석이 안되는 부분)에 대해서 물어보고 답해주고 물어보고 답해주고...이렇게 쓰니까 도움이 되네요. 플러그인 써서 pdf 읽게 하고 하면 도움이 많이 됩니다.

저도요 이메일 작성 초록 작성 할 때 너무 좋네요 ^^

저는 파이썬에서 그래프 그릴때 잘 써요!

답을 알고 있으면서 어떻게 표현할지 잘 모를때 쓰면 괜찮더라구요

맞아요 맞아요.. 영작 할 때도 같은 느낌입니다.

한국말로 쓰고 그걸 영어로 바꿔주삼하면 좀 엉성하고 .. 영어로 괴발개발 ... 기초 수준으로 써놓고 academical words로 바꿔달라하면 기깔나게 바꿔줍니다 ㅎㅎㅎㅎㅎㅎ

제가 알기로는 chat GPT는 학습을 통해 지식을 습득해서 그런걸로 알고 있습니다.

여기서 학습이라 함은 수많은 데이타를 마구마구 돌려가면서 가장 많은 경우의 수가 나오는 걸 말합니다. 즉, 동전 한두번 던져서 앞뒤면의 확률이 1/2 라고 나오기 힘들듯 동전을 백번 천번 던져서 확률 1/2 에 도달 하는 것과 비슷한겁니다.

즉, 데이타가 많이 있는 것들은 결과가 잘 나오고, 데이타가 별로 없는건 결과가 애매 하게 나올 수 밖에 없습니다.

여기서 데이타는 주로 internet 인데, 인터넷에 쌓인 데이터가 언어부분은 많이 쌓여 있어서 ( 지금 이렇게 글 올리는 것도 언어이니...),

아마도 글은 기가 막히게 쓸 겁니다. 하지만, 연산 부분은 상대적으로 데이타가 적을 수 밖에 없어서 정확성이 떨어질 수 밖에 없습니다.

예를 들자면 1+1=2 인 답을 내는게 우리가 생각 하듯이 1+1을 연산으로 답을 내는게 아니라. 인터넷에서 1+1 = 2 라고 나오는 수많이 데이터를

반복적으로 봤을때에 확률적으로 1+1=2라는 게 많이 보이드라해서 1+1 = 2 라고 답을 내는 겁니다.

누군가가 미친척하고 인터넷에 1+1 = 1 이라는 에디슨 같은 생각의 데이터를 인터넷에 마구마구 뿌린다면 chat gpt는 1+1=1 이다라고 대답 할 수 밖에 없습니다.

그래서 이에 대한 보안으로 BARD 는 연산 module을 넣었대나 하는것 같습니다. BARD 의 경우에는 아마도 수식을 구분 해내서, 이게 연산이면,

연산 module 로 따로 뽑아 낼겁니다.

댓글 [26]